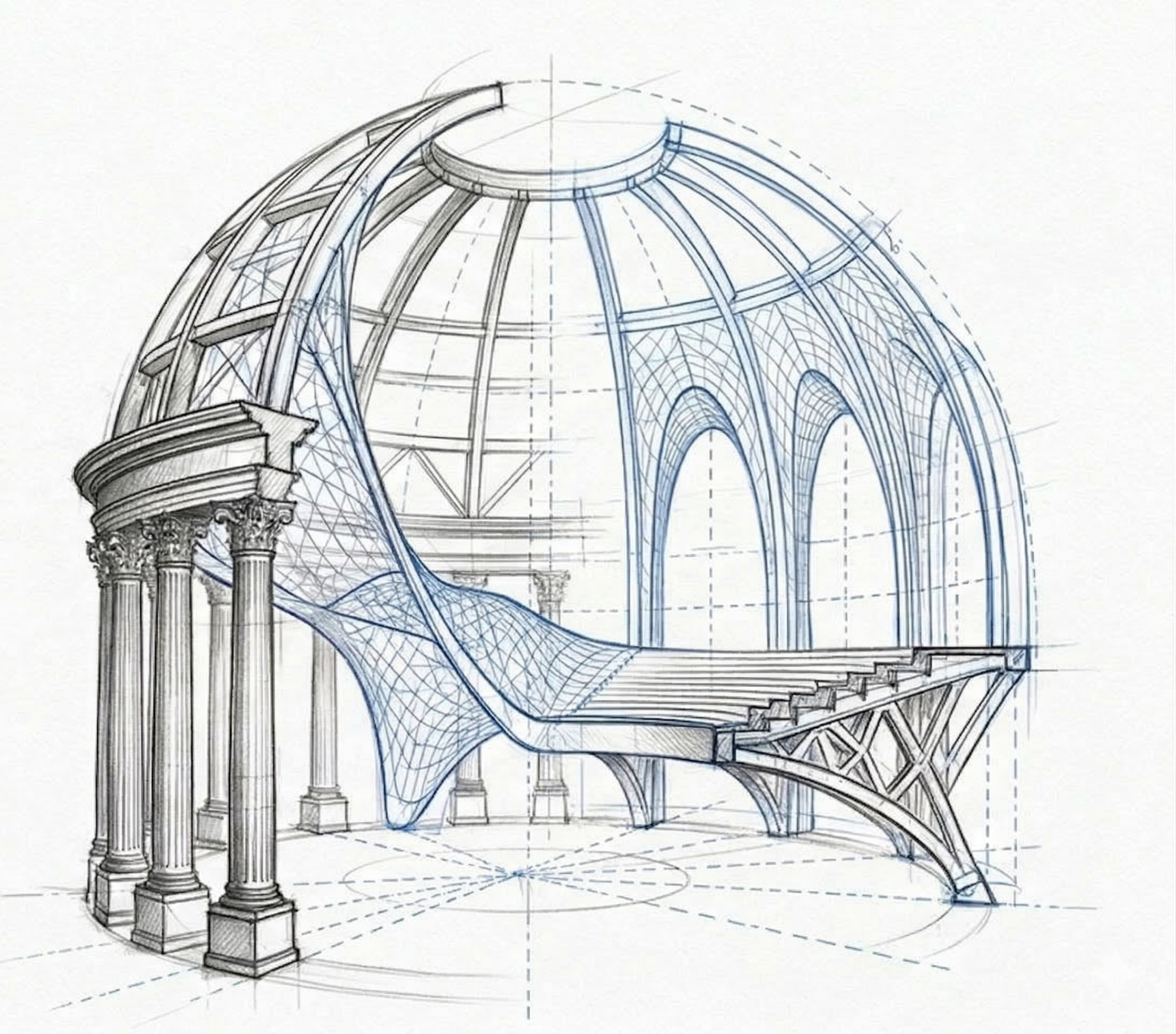

Starting base

This image serves as the foundation from which the AI extrapolates the three-dimensional geometry (mesh), vertices, and topology of the final 3D model.  Continue la lecture

Continue la lecture

Starting base

This image serves as the foundation from which the AI extrapolates the three-dimensional geometry (mesh), vertices, and topology of the final 3D model.  Continue la lecture

Continue la lecture

La génération d’images par intelligence artificielle franchit un cap décisif pour la pratique architecturale. Des outils comme ComfyUI permettent aujourd’hui de construire des chaînes de traitement sophistiquées — render photoréaliste, transfert de style, recomposition d’ambiance — en connectant visuellement des nœuds de traitement. Ce billet présente les objectifs de la session exploratoire, les modèles employés, et les cas d’usage concrets testés.

L’ambition de cet atelier est de replacer l’IA générative dans des situations concrètes de travail de projet : partir d’une image existante — esquisse, vue 3D, référence photographique — et la transformer de façon contrôlée pour produire des rendus convaincants, des ambiances réalistes, ou des planches de concours.

ComfyUI s’impose ici comme l’environnement de prédilection : contrairement à des interfaces comme Midjourney, il offre une maîtrise totale du pipeline. Chaque étape est visible, paramétrable, reproductible. On peut injecter des images de référence, contrôler la diffusion, chaîner des modèles spécialisés. Continue la lecture

Test upon a complex shape

Will it be possible to convert this sketch into a 3D model. Let’s try out and compare the results. Continue la lecture